Faça uma experiência e pergunte ao ChatGPT — o robô de inteligência artificial (IA) criado pela empresa americana OpenAI, hoje financiada pela Microsoft — o que ele acha do anúncio de que oito jornais dos Estados Unidos, entre eles o Chicago Tribune, abriram um processo contra a empresa por violação de direitos autorais, ao beber de milhões de notícias publicadas anteriormente. A resposta virá banhada de sinceridade e cautela.

Assim: “Os jornais têm todo o direito de proteger seus ativos de propriedade intelectual, incluindo suas matérias jornalísticas, que são protegidas por direitos autorais. Se eles alegam que a OpenAI está utilizando seus conteúdos sem a devida autorização, é uma questão séria que merece ser investigada legalmente”. É problema que ainda vive a infância, crescerá com o tempo e desde já abre uma imensa avenida de discussões éticas.

O estopim do atual quiproquó legal foi uma ação movida pelo The New York Times, em dezembro do ano passado. As alegações, para além da subtração de conteúdo não autorizado: um pontapé na credibilidade, a criação de histórias irreais, ao juntar alhos com bugalhos, e a evidente concorrência desleal. A briga mal começou, e sabe-se lá como pode terminar, mas é certo que já não se pode tirar o bode da sala.

Acordos começam a ser desenhados, mas é improvável que a OpenAI saia vitoriosa. “As empresas jornalísticas precisam ser indenizadas quando o resultado da tecnologia gera um produto conflituoso, de objetivos semelhantes”, diz Allan Rocha, professor da UFRJ e diretor científico do Instituto Brasileiro de Direitos Autorais. “Mas não podemos criar barreiras tão duras que impeçam o desenvolvimento tecnológico.”

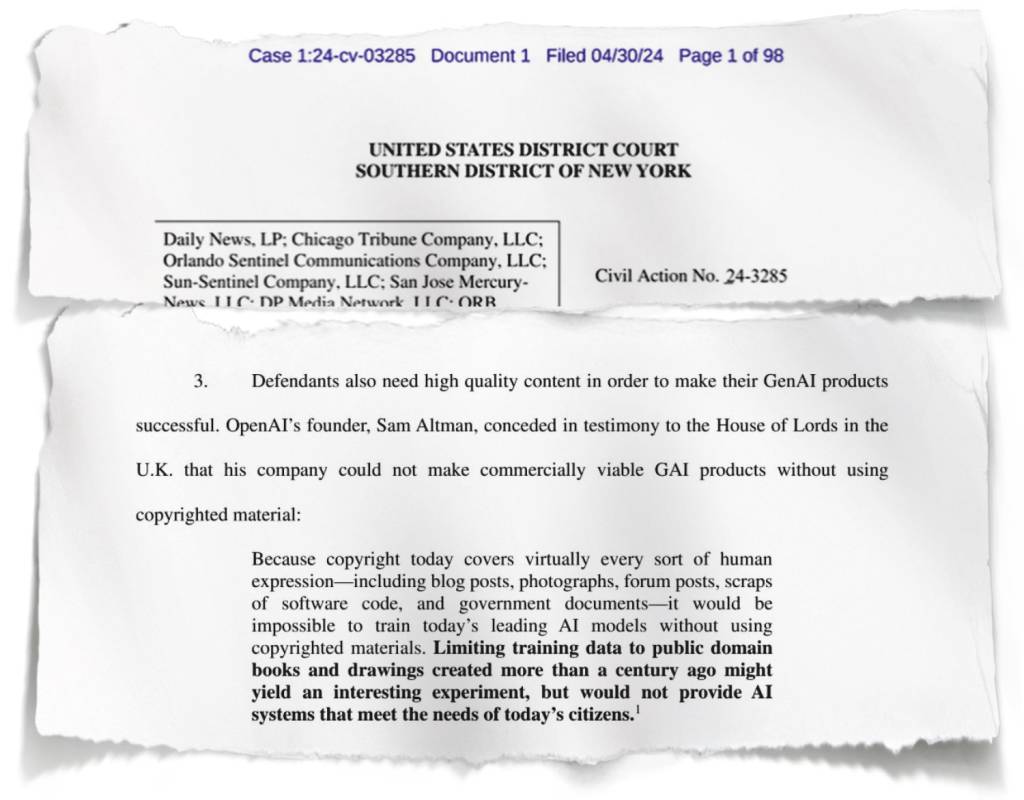

De fato, mecanismos ao estilo do ChatGPT precisam se alimentar do maior volume disponível de dados para fazer o que fazem, ao emular respostas humanas. A OpenAI argumenta ser impossível “prover sistemas que satisfaçam às necessidades atuais dos cidadãos” utilizando quantidade limitada de informações. Daí o natural apoio no jornalismo. Contudo, é inaceitável que possam ferir o bom senso, em desrespeito à livre iniciativa.

O caminho mais nítido, certamente o mais rápido, mas economicamente inviável, seria simplesmente pagar o preço justo pelo uso do noticiário. Foi esse, aliás, o entendimento da União Europeia. Em recente decisão, determinou-se que todo conteúdo com dono deva ser remunerado. Na contramão, porém, países como Singapura e Japão apostam na liberdade total, de modo a acelerar as tecnologias — deixando para depois o veredicto final. É um erro, também, empurrar a contenda para os parlamentos políticos. “A sociedade deve antes discutir o tema, compreender os limites, saber que inexiste um consenso, e aí partir para algum tipo de legislação”, diz Rocha.

E, como sempre, convém acompanhar o que fazem os personagens da batalha que fogem do radicalismo. Empresas de comunicação como a The Associated Press, a Axel Springer e, mais recentemente, o Financial Times (FT), fizeram acertos com a OpenAI . Mediante o pagamento de valores não revelados, mas considerados coerentes, a mineração do jornalismo está liberada, desde que o ChatGPT sugira a leitura dos originais, quando for o caso. O FT tratou ainda de iniciar o estudo de uma máquina própria conduzida por IA. “Toda empresa de jornalismo vai precisar de IA, seja para material primário, seja para processamento de dados”, diz Anderson Rocha, pesquisador e coordenador do Laboratório de Inteligência Artificial da Universidade Estadual de Campinas. “É difícil dizer a que ponto chegaremos, mas acredito numa convivência amigável.”

Não se trata de demonizar o uso de tecnologias como o ChatGPT — elas não são, de modo algum, um mal em si. Tudo depende de como nós, humanos, as usamos. Inexistem certezas absolutas, à exceção de uma: o jornalismo profissional, como o de VEJA, baseado em verificação cuidadosa e respeito à verdade, é inegociável.

Publicado em VEJA de 10 de maio de 2024, edição nº 2892

SEGUIR

SEGUIR

SEGUINDO

SEGUINDO

Quem são as principais concorrentes de Fernanda Torres no Oscar

Quem são as principais concorrentes de Fernanda Torres no Oscar Sem dinheiro: o risco de apagão no Banco Central

Sem dinheiro: o risco de apagão no Banco Central Internacional contrata consultoria americana para atrair sócios-torcedores

Internacional contrata consultoria americana para atrair sócios-torcedores ‘Operação Lioness’: brasileira reforça onda da espionagem feminina na tela

‘Operação Lioness’: brasileira reforça onda da espionagem feminina na tela