Ofensiva de Dino amplia pressão do governo sobre plataformas digitais

Na esteira de dois atentados em escolas e em meio a boatos de outros ataques, pacote põe as big techs acertadamente na mira — o que deve gerar resistências

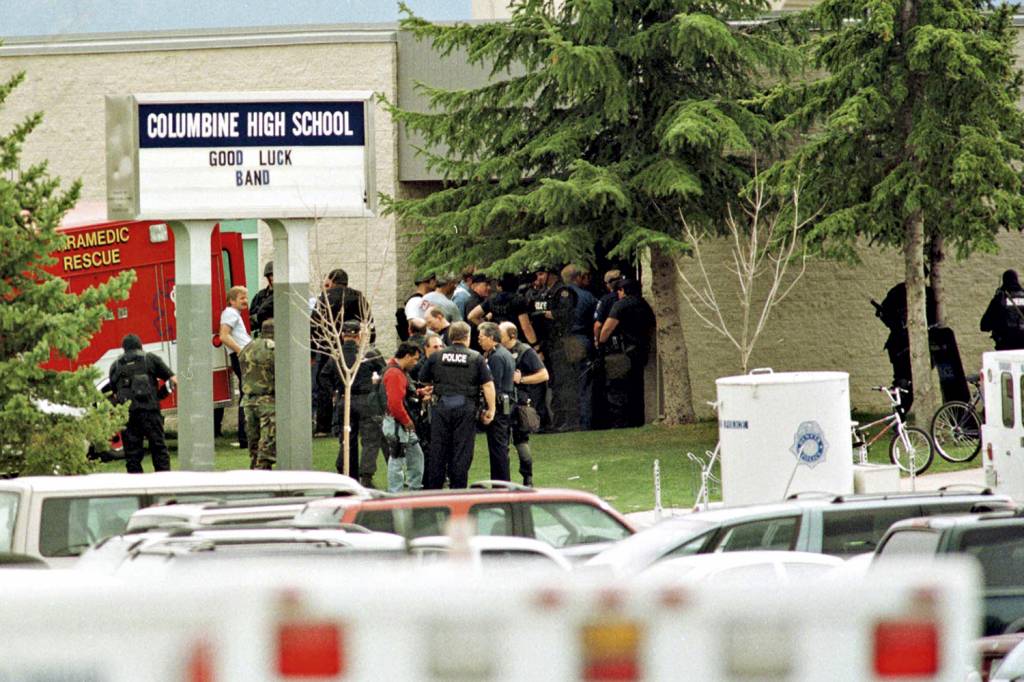

A queda de braço entre o Estado brasileiro e as grandes companhias de tecnologia já vinha se desenhando desde o início do ano, quando, na esteira dos atos golpistas de 8 de janeiro, o governo Lula sinalizou que iria pressionar as empresas para obrigá-las a ser mais proativas na regulação dos seus conteúdos, em especial fake news e ataques à democracia. A batalha, que mal começara, escalou muito na quarta 12. Pressionado por atentados em escolas, o ministro da Justiça e Segurança Pública, Flávio Dino, divulgou a maior ofensiva já feita pelo poder público para enquadrar as big techs. O anúncio ocorreu em meio a um crescente clima de pânico em razão da profusão de ameaças de novas agressões em ambientes escolares no próximo dia 20, data do aniversário do massacre na Columbine High School (EUA), que deixou quinze mortos em 1999 e virou referência para uma legião de pseudoterroristas digitais.

O pacote, que inclui uma portaria e um processo administrativo para cada companhia, toca em pontos sensíveis para as plataformas — e que devem gerar resistências. Um deles é a determinação para que digam se retiram conteúdos impróprios sem serem provocadas pela Justiça. Também serão exigidos protocolos adotados contra a disseminação de ódio e a obrigatoriedade de compartilharem imediatamente com a polícia qualquer dado que permita a identificação de quem propaga esse tipo de conteúdo. Outro ponto de discórdia é a exigência de que informem como funcionam seus algoritmos e por que eles possibilitam a recomendação de conteúdos violentos até para menores de idade. Dino citou o Código Civil, o Código de Defesa do Consumidor e o Marco Civil da Internet para dizer que há legislação suficiente para permitir punições, incluindo a suspensão das plataformas. “Estamos buscando monitoramento, moderação e o fim desse macabro e vil mercado da morte”, disse.

O aumento da tensão foi impulsionado por dois trágicos eventos. Em 27 de março, em São Paulo, um aluno de 13 anos matou uma professora e esfaqueou cinco pessoas — ele usava no Twitter o sobrenome de um atirador do massacre de Suzano, que deixou dez mortos em uma escola em 2019. No último dia 5, em Blumenau (SC), um homem invadiu uma creche, matou quatro crianças e feriu cinco a golpes de machadinha — instrumento também usado em Suzano e que se tornou comum em episódios desse tipo pelo país. O crime bárbaro fez grandes veículos de imprensa, entre eles VEJA, adotarem o protocolo de não divulgar nome, foto ou vídeo do assassino, para não contribuir para a viralização de seu perfil na internet.

As redes sociais nada fizeram. Por essa razão, acertadamente, entraram na mira do governo. De imediato, o Ministério da Justiça pediu a exclusão de 546 perfis no Twitter que promoviam hashtags relacionadas a ataques em escolas. O representante da empresa ouviu a cobrança pessoalmente na segunda 10, em reunião de Dino com emissários da Meta (Facebook, Instagram e WhatsApp), Google, TikTok e Kwai, e criou desconforto ao alegar que um perfil com foto de assassinos de crianças não violava os termos de uso da rede. Dino disse que termos de uso “não se sobrepõem à Constituição”, o Ministério Público anunciou que iria investigar a postura da companhia e o Twitter logo entendeu os recados: em uma nova reunião, mostrou “disposição” para moderar os seus conteúdos.

Publicamente, as empresas dizem estar dispostas a atender ao que pede o governo, mas ressalvam que é cedo para avaliar o que pode ser feito na prática. Em nota, o Google declara já usar uma combinação de inteligência artificial e revisores humanos para identificar, avaliar e remover conteúdo nocivo do YouTube. “Temos colaborado constantemente com as autoridades no fornecimento de dados para apoiar investigações sobre pessoas ou grupos que fazem apologia à violência em escolas”, afirma o texto. A Meta diz não permitir conteúdos ligados a terrorismo, atos organizados de ódio, assassinato em massa ou chacinas, tráfico humano e violência organizada ou atividade criminosa. “Também removemos conteúdo que expresse apoio ou exalte grupos, líderes ou pessoas envolvidas nessas atividades”, declara a companhia, também por meio de uma nota oficial.

A resposta do poder público, embora incisiva, é um tanto tardia para uma tragédia mais do que anunciada. A proliferação do extremismo nas redes sociais e a radicalização dos jovens são denunciadas há anos por especialistas fora do meio político. Um deles é a pesquisadora Michele Prado, da USP, que monitora comunidades de exaltação à violência nas escolas por meio de hashtags. O grupo coordenado por ela identificou pontos de contato entre inúmeras vertentes extremistas na internet — movimentos neonazistas, de misoginia, conspiração, negacionismo, terrorismo e até satanismo se encontram e fortalecem mutuamente suas ideologias. “Assim, formam uma máquina de propagação do ódio”, conclui Michele. A forma como adolescentes são seduzidos também é tema do antropólogo David Nemer, professor de estudos de mídia da Universidade da Virgínia. “A principal tática é explorar vulnerabilidades emocionais e convencer o jovem de que suas frustrações são fruto de injustiças”, afirma ele. Para vítimas de bullying, por exemplo, o discurso busca direcionar a raiva do aluno contra colegas e professores.

A ausência de dados, leis e estudos abrangentes sobre o vasto escopo de subculturas violentas torna hercúleo o combate ao extremismo. Um dos que se dedicam a isso é o delegado Arthur Lopes, da Polícia Civil de Santa Catarina, que lidera as investigações contra recrutadores neonazistas que aliciam adolescentes. Esse processo ocorre frequentemente através de jogos on-line, fóruns da deep web e plataformas como os aplicativos de mensagem Discord e Signal e a rede social russa VK. Em boa parte das vezes, os recrutadores introduzem os adolescentes em comunidades nas quais são bombardeados por conteúdos ilegais. Alguns são incentivados a interpretar um “personagem” e realizar um atentado, prática conhecida como larp (live action role playing), uma referência a jogos de RPG. Um caso de pessoa flagrada fazendo esse tipo de jogo macabro foi o da prisão de um neonazista de 19 anos em Porto Belo (SC), em 17 de março, por incitação à violência contra negros e judeus.

Identificar a tempo esse tipo de ameaça é um desafio que exige esforços em várias frentes. Além do pacote emergencial lançado nesta semana, o governo também aposta na alteração do artigo 19 do Marco Civil da Internet, de 2014, que exime as plataformas da obrigação de remover conteúdo quando solicitado, exceto em caso de ordem judicial. A ideia tem entre suas inspirações o Digital Services Act (DSA), lei que vigora na União Europeia desde novembro passado e obriga as empresas a implementar ferramentas para detectar e remover conteúdos nocivos. A nova escalada na discussão do tema no Brasil impactou favoravelmente o PL das Fake News, projeto que muda o Marco Civil e que passou a contar com o apoio do governo. Nos últimos dias, o relator, Orlando Silva (PCdoB-SP), esteve em conversas com líderes partidários para destravar a proposta e recebeu sinal positivo do presidente da Câmara, Arthur Lira (PP-AL). “A perspectiva é que o texto seja levado ao plenário em maio”, diz Silva.

Paralelamente, tramita no STF um julgamento que pode revogar o artigo 19 a partir de duas ações: uma movida em 2014 contra o Facebook por uma dona de casa que descobriu um perfil falso em seu nome; e outra de 2010, por uma professora que processa o Google, em razão de uma comunidade depreciativa contra ela criada por alunos no Orkut. Nos Estados Unidos, onde não há lei que responsabilize as plataformas por conteúdo de terceiros, está em análise na Suprema Corte um processo contra o Google que pode representar um marco histórico. A família de Nohemi Gonzalez, que morreu aos 23 anos em atentado do Estado Islâmico em Paris, acusa o YouTube de permitir que a organização usasse a plataforma para recrutar terroristas e que, por isso, deve ser responsabilizado.

Tanto o Brasil quanto outros países enfrentam o dilema de combater o problema sem cair na armadilha da censura. Uma lei muito ampla pode se tornar ferramenta para silenciar opositores. Uma regra muito rígida pode levar as plataformas a pesar a mão na moderação e excluir qualquer conteúdo que possa ser interpretado como violento — exemplos recentes vieram do Chile e Colômbia, onde vídeos que denunciavam a brutalidade policial foram derrubados pelas redes. “Há o risco de darmos muito poder de moderação às plataformas e, na prática, criarmos uma privatização da regulação”, alerta a diretora de Políticas para a América Latina da Electronic Frontier Foundation, Veridiana Alimonti. A tarefa de achar um ponto de equilíbrio não é de fato simples, mas os acontecimentos recentes mostram que essa batalha contra a disseminação de ódio e violência nas redes tornou-se ainda mais urgente diante dos novos e chocantes episódios de ataques.

Publicado em VEJA de 19 de abril de 2023, edição nº 2837

SEGUIR

SEGUIR

SEGUINDO

SEGUINDO